Семантическая информация

В 50-х годах XX века появились первые попытки определения абсолютного информационного содержания предложений естественного языка. Стоит отметить, что сам Шеннон однажды заметил, что смысл сообщений не имеет никакого отношения к его теории информации, целиком построенной на положениях теории вероятностей. Но его способ точного измерения информации наводил на мысль о возможности существования способов точного измерения информации более общего вида, например, информации из предложений естественного языка. Примером одной из таких мер является функция inf(s) = −log2p(s), где s — это предложение, смысловое содержание которого измеряется, p(s) — вероятность истинности s.

Вот некоторые свойства этой функции-меры:

1) если s1 → s2 (из s1 следует s2) — истинно, то inf(s1) > inf(s2);

2) inf(s) ≥ 0;

3) если s — истинно, то inf(s) = 0;

4) inf(s1s2) = inf(s1) + inf(s2) ⇔ p(s1 · s2) = p(s1) p(s2), т. е. независимости s1 и s2.

Значение этой функция-меры больше для предложений, исключающих большее количество возможностей. Пример: из s1 — “a > 3” и s2 — “a = 7” следует, что s2 ⇒ s1 или inf(s2) ≥ inf(s1); ясно, что s2 исключает больше возможностей, чем s1.

Для измерения семантической информации также используется функция-мера cont(s) = 1 − p(s). Ясно, что cont(s) = 1 − 2−inf(s) или inf(s) = −log2(1 − cont(s)).

Сжатие информации

Цель сжатия—уменьшение количества бит, необходимых для хранения или передачи заданной информации, что дает возможность передавать сообщения более быстро и хранить более экономно и оперативно (последнее означает, что операция извлечения данной информации с устройства ее хранения будет проходить быстрее, что возможно, если скорость распаковки данных выше скорости считывания данных с носителя информации). Сжатие позволяет, например, записать больше информации на дискету, “увеличить” размер жесткого диска, ускорить работу с модемом и т.д. При работе с компьютерами широко используются программы-архиваторы данных формата ZIP, GZ, ARJ и других.

Методы сжатия информации были разработаны как математическая теория, которая долгое время (до первой половины 80-х годов), мало использовалась в компьютерах на практике.

Сжатие данных не может быть большим некоторого теоретические предела. Для формального определения этого предела рассматриваем любое информационное сообщение длины n как последовательность независимых, одинаково распределенных д.с.в. Xi или как выборки длины n значений одной д.с.в. X.

Доказано, что среднее количество бит, приходящихся на одно кодируемое значение д. с. в., не может быть меньшим, чем энтропия этой д.с.в., т.е. ML(X) ≥ HX для любой д.с.в. X и любого ее кода.

Кроме того, доказано утверждение о том, что существует такое кодирование (Шеннона-Фэно, Fano), что HX > ML(X) − 1.

Рассмотрим д.с.в. X1 и X2, независимые и одинаково распределенные. HX1 = HX2 и I(X1,X2) = 0, следовательно,

H(X1,X2) = HX1 + HX2 − I(X1,X2) = 2HX1.

Вместо X1 и X2 можно говорить о двумерной д. с. в. X→ = (X1, X2).

Аналогичным образом для n-мерной д.с.в. X→ = (X1, X2, . . . , Xn) можно получить, что HX→ = nHX1.

Пусть L1(X→) = L(X→)/n, где X→ = (X1, X2, . . . , Xn), т.е. L1(X→ ) — это количество бит кода на единицу сообщения X→ . Тогда ML1(X→) — это среднее количество бит кода на единицу сообщения при передаче бесконечного множества сообщений X→ . Из ML(X→) − 1 ≤ HX→ ≤ ML(X→) для кода Шеннона-Фэно для X→ следует ML1(X→) − 1/n ≤ HX1 ≤ ML1(X→) для этого же кода.

Таким образом, доказана основная теорема о кодировании при отсутствии помех, а именно то, что с ростом длины n сообщения, при кодировании методом Шеннона-Фэно всего сообщения целиком среднее количество бит на единицу сообщения будет сколь угодно мало отличаться от энтропии единицы сообщения. Подобное кодирование практически не реализуемо из-за того, что с ростом длины сообщения трудоемкость построения этого кода становится недопустимо большой.

Кроме того, такое кодирование делает невозможным отправку сообщения по частям, что необходимо для непрерывных процессов передачи данных.

Дополнительным недостатком этого способа кодирования является необходимость отправки или хранения собственно полученного кода вместе с его исходной длиной, что снижает эффект от сжатия. На практике для повышения степени сжатия используют метод блокирования.

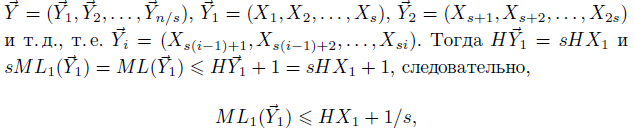

По выбранному значению ε > 0 можно выбрать такое s, что если разбить все сообщение на блоки длиной s (всего будет n/s блоков), то кодированием Шеннона-Фэно таких блоков, рассматриваемых как единицы сообщения, можно сделать среднее количество бит на единицу сообщения большим энтропии менее, чем на ε. Действительно, пусть

т.е. достаточно брать s = 1/". Минимум s по заданному " может быть гораздо меньшим 1/ε.

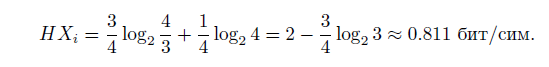

Пример. Пусть д.с.в. X1, X2, . . . Xn независимы, одинаково распределены и могут принимать только два значения P(Xi = 0) = p = 3/4 и P(Xi = 1) = q = 1/4 при i от 1 до n. Тогда

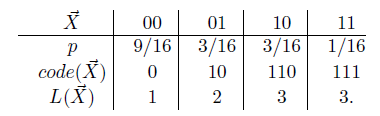

Минимальное кодирование здесь — это коды 0 и 1 с длиной 1 бит каждый. При таком кодировании количество бит в среднем на единицу сообщения равно 1. Разобьем сообщение на блоки длины 2. Закон распределения вероятностей и кодирование для 2-мерной д.с.в. X→ = (X1, X2)

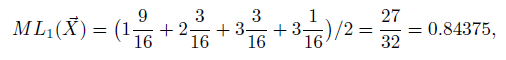

Тогда при таком минимальном кодировании количество бит в среднем на единицу сообщения будет уже

т.е. меньше, чем для неблочного кодирования. Для блоков длины 3 количество бит в среднем на единицу сообщения можно сделать ≈ 0.823, для блоков длины 4 — ≈ 0.818 и т.д.

Все изложенное ранее подразумевало, что рассматриваемые д.с.в. кодируются только двумя значениями (обычно 0 и 1). Пусть д.с.в. кодируются m значениями. Тогда для д.с.в. X→ и любого ее кодирования верно, что ML(X→) > H X→/ log2m и ML1(X→) ≥ HX1/ log2m. Кроме того, существует кодирование такое, что ML(X→) − 1 ≤ HX→/ log2m и ML1(X→) − 1/n ≤ HX1/ log2m, где n = dim(X→).

Формулы теоретических приделов уровня сжатия, рассмотренные ранее, задают предел для средней длины кода на единицу сообщений, передаваемых много раз, т.е. они ничего не говорят о нижней границе уровня сжатия, которая может достигаться на некоторых сообщениях и быть меньшей энтропии д.с.в., реализующей сообщение.